一、简单介绍

OpenClaw 是一款基于 MIT 开源协议的 AI 智能体(Agent)执行网关,由 Peter Steinberger 主导开发,其前身为 Clawdbot 和 Moltbot,核心定位是自托管的 AI 执行中枢,无需复杂编码,即可通过自然语言指令驱动本地设备完成自动化操作。区别于纯对话型 AI,它能真正实现“动手做事”,连接大语言模型、通讯渠道与系统工具,兼顾隐私安全与功能灵活性,适配个人、企业及开发者多类需求,可部署在 Mac mini、Windows PC、Linux 系统及树莓派等设备上,是一款功能强大的开源个人 AI 助手。

二、核心特点

-

双部署模式:支持零代码官方托管版(新手首选)和自托管部署版(本地/服务器,完全自主可控),适配不同技术基础用户。

-

模型兼容性强:可对接 OpenAI、Claude、Gemini 等云端 API 模型,也支持通过 Ollama 部署本地离线模型,无需 API Key 即可离线使用,还能实现多模型回退切换。

-

多端交互灵活:无需专用 APP,可通过网页端直接对话,也能接入微信、飞书、Telegram、Discord、Slack 等20+日常聊天平台,实现远程操控设备,群聊、私聊均可调用。

-

功能模块化:采用分层架构,涵盖网关核心、交互、LLM 决策、工具执行、记忆五大模块,支持插件化技能扩展,官方技能市场(ClawHub)已收录超 5700 个社区技能,还可自主开发技能插件。

-

隐私优先:默认本地存储所有数据(会话记录、执行日志等),无云端数据上传,配置本地模型后可完全断网使用,数据100%本地私有,隐私安全可控。

-

跨平台适配:支持 Windows、macOS、Linux 全系统,服务器部署可选择香港/海外节点,适配国内网络环境,也可部署在 Mac mini M2、树莓派等低功耗设备上实现24小时运行。

-

自主化程度高:具备自适应学习引擎,可通过持续交互掌握用户习惯和偏好,实现任务自主执行,无需反复手动触发,相当于“数字分身”。

三、优点

-

实操性强:可直接操控本地系统,实现文件读写、终端命令执行、浏览器自动化、键鼠模拟、网页数据提取、表单填写等实际操作,替代重复性人工任务,真正“动手做事”而非单纯对话。

-

上手路径多元:托管版开箱即用,5 分钟即可完成配置;自托管提供一键脚本、Docker 容器化、源码编译三种方式,还配备图形化向导和 Web 仪表盘,零基础也能15分钟上手。

-

开源可定制:基于 MIT 开源协议,无商业使用限制,支持开发者二次开发、自定义修改源码,拓展功能边界,还能参与社区贡献完善项目。

-

场景覆盖广:从个人日常杂事处理到企业级业务流程自动化,再到开发者技术试验、边缘嵌入式场景,均可适配,实用性强。

-

记忆连贯:具备持久记忆功能,可记住用户偏好和任务细节,保障多轮对话、跨会话的任务连贯性,无需反复下达指令,记忆容量不受 Token 限制,取决于设备存储空间。

-

成本可控:软件完全免费开源,无月度订阅费用,仅产生硬件部署和 AI 模型 API 调用的使用成本,可根据需求选择低成本或零硬件投入方案。

-

生态丰富:支持100+应用集成,涵盖通讯、办公、开发、娱乐等多个领域,社区活跃,技能插件持续更新,还能让 AI 自主创建和实现新技能。

四、缺点

-

部署门槛不均:自托管模式需安装 Node.js、Git 等依赖,配置模型 API 或本地模型,非技术用户上手难度较大,需逐步学习配置流程,原生 Windows 系统安装体验不如 macOS/Linux 流畅。

-

存在权限风险:具备本地系统全访问权限,恶意或错误指令可能导致文件删除、系统异常,建议用专用用户或 Docker 沙箱运行,降低风险。

-

性能依赖外部条件:响应速度和执行效率受本地设备算力(本地模型)、网络状况(云端模型)影响,配置不足时体验下降,本地模型运行需较高硬件配置(如 NVIDIA 显卡、Apple Silicon)。

-

生态适配待优化:部分小众通讯渠道、工具插件存在兼容性问题,稳定性需进一步提升,社区衍生插件质量参差不齐。

-

指令要求较高:模糊指令易导致执行偏差,用户需熟悉指令编写技巧,明确任务目标、执行要求和交付标准才能获得理想效果,复杂自动化任务需反复测试调整。

-

迭代速度快:项目处于高频迭代阶段,名称、功能更新频繁,可能出现版本兼容问题,需及时关注更新日志。

五、使用场景

-

个人日常自动化:处理繁琐重复杂事,如批量整理文件、取消邮件订阅、预订航班值机、生成日常简报、查询系统状态、清理收件箱、转写语音备忘录等,解放双手。

-

企业级业务自动化:打造“硅基员工”,应用于营销、客服、招聘、巡检等场景,如提升咨询转化率、缩短招聘周期、驱动巡检机器人作业、生成初步社交媒体帖子等。

-

开发者场景:作为 AI Agent 开发试验田,用于二次开发、自定义技能编写、部署轻量化 AI 终端,或优化现有程序、调试系统问题、执行自动化部署、搭建 ETL 数据处理流水线等。

-

隐私敏感场景:处理涉密数据、本地文档解析、离线任务执行,如提取 PDF 核心条款、本地数据统计等,无需担心数据泄露,尤其适合处理敏感办公数据。

-

远程操控场景:通过聊天平台远程控制本地/服务器设备,执行文件操作、启动程序、查看设备状态、重建网站等,实现跨场景便捷操作,无需随时打开电脑。

-

多媒体处理场景:借助社区技能实现视频帧提取、图片字幕添加、音频转文字等操作,适配设计师、内容创作者日常需求。

六、实际应用

-

个人应用:自动化整理电脑文件、生成工作总结/简报、精听摘要、批量处理邮件、查询实时资讯并生成精简内容,通过 Telegram 远程操控电脑完成文件传输、程序启动,解放双手;利用持久记忆功能记录个人偏好,实现个性化任务执行。

-

企业应用:百融云创用其打造“百盈”销服专员、“百才”招聘专员,提升转化率、缩短招聘周期;软通动力将其融入工业互联,驱动巡检机器人 7×24 小时作业,降低成本;营销团队用其协调日程、发送通知、生成初步营销文案,提升工作效率。

-

开发者应用:二次开发自定义技能插件、部署轻量化 AI 终端(如树莓派、旧手机)、优化代码性能、调试分布式系统问题、搭建 ETL 数据处理流水线,还可通过源码修改拓展功能,参与社区贡献;利用其执行 GitHub 告警处理、自动化部署等任务。

-

边缘场景:通过轻量化部署,在 RISC-V 开发板、树莓派等设备上启动,实现嵌入式场景的 AI 自动化操作,拓展 AI 应用边界;Mac mini M2 用户可将其部署为低功耗24小时运行的 AI 助手,实现全天候任务自动化。

-

真实用户案例:产品经理用其整理收件箱、协调会议日程、生成邮件回复草稿;自由设计师通过其对接 Discord、Telegram 客户消息,无需持续监控设备;数据科学家用其开发定制化分析自动化工具,提升报告生成效率。

七、如何使用(分两种核心路径)

路径一:零代码官方托管版(非技术用户首选,5 分钟上手)

-

注册登录:访问官方托管平台 openclawd.ai,通过邮箱或 Google 账号完成注册登录。

-

模型配置(核心步骤):进入左侧“模型设置”,选择模型服务商(Claude、GPT、Gemini 等),粘贴对应平台 API Key 并填写正确 Base URL(国内模型需替换为国内接口地址),点击“测试连接”,成功后设为默认模型;若选择本地模型,需提前安装 Ollama 并拉取对应模型(如 qwen2.5:32b)。

-

选择交互方式:可通过网页端“Chat”面板直接对话,或进入“Channels/渠道”,授权配置微信、飞书、Telegram、Discord 等聊天平台,实现聊天框调用,群聊@即可触发指令。

-

扩展能力:进入“ClawHub 技能市场”,一键安装所需技能(如文档处理、网页搜索、视频帧提取),安装后自动生效,可在“我的技能”配置权限,关闭不需要的技能减少资源占用。

-

正式使用:在网页端或已接入的聊天平台,用自然语言下达具体指令(指令越具体越好),即可自动执行任务,示例:“帮我创建 10 页简约商务风年度工作总结 PPT,保存在桌面‘工作总结’文件夹”“帮我抓取某网站10篇文章并生成精简摘要,发送到我的 Telegram”。

路径二:自托管部署版(开发者/隐私需求用户,完全自主可控)

方式 1:一键脚本安装(全平台通用,新手推荐)

-

打开终端:macOS/Linux 直接打开系统终端;Windows 以管理员身份打开 PowerShell 或 CMD(推荐安装 WSL2 后在 Ubuntu 环境下安装,体验更流畅)。

-

安装依赖:提前安装 Node.js 22+(macOS 可通过 Homebrew 安装:brew install node@22;Linux 可通过 curl 命令安装;Windows 可通过官方安装包安装),确保终端可正常执行 npm/pnpm 命令。

-

执行一键安装命令:macOS/Linux/WSL 输入

curl -fsSL https://openclawd.ai/install.sh | bash;Windows PowerShell 输入iwr -useb https://openclawd.ai/install.ps1 | iex,脚本会自动安装并启动配置向导。 -

向导配置:执行

openclawd onboard初始化助手,依次完成 Agent 身份设置、主模型选择(云端 API 或本地 Ollama 模型)、工作区配置(默认 ~/.openclaw/workspace,存放记忆和配置文件)、Daemon 服务安装(选择“Yes”实现开机自启)、初始技能安装(推荐安装官方基础技能)。 -

验证安装:输入

openclaw --version,显示版本号即安装成功;输入openclaw doctor可检查配置健康状态。 -

后续操作:配置聊天渠道(Telegram、Discord 等),安装所需技能,下达自然语言指令即可使用;启动助手输入

openclaw start,关闭输入openclaw stop。

方式 2:Docker 容器化安装(最安全,适合24小时运行)

-

前提准备:已安装 Docker 并启动 Docker 服务,确保设备具备网络连接。

-

执行安装命令:输入

docker run -d --name openclaw -v ~/.openclaw:/root/.openclaw -p 18789:18789 openclaw/openclaw:latest,一键启动沙箱容器,隔离系统权限,降低安全风险。 -

配置与使用:通过

localhost:18789访问 Web 控制台,完成模型配置、渠道对接和技能安装,后续操作与一键脚本安装一致,容器会自动后台运行,重启设备后需重新启动容器。

方式 3:源码编译安装(开发者/贡献者首选)

-

克隆源码:终端输入

git clone https://github.com/openclawd/openclawd.git,进入项目目录cd openclawd。 -

安装依赖:输入

pnpm install,等待依赖安装完成;若未安装 pnpm,需先执行npm install -g pnpm。 -

编译项目:输入

pnpm run build,编译完成后执行pnpm link --global,将命令全局可用。 -

初始化配置:输入

openclawd onboard,完成向导配置,即可启动使用;可修改源码实现自定义功能,提交代码参与社区贡献。

八、学习资源(含官网相关)

1. 官方核心资源

-

官网:https://openclawd.ai(含完整安装指南、功能介绍、FAQ,可直接访问体验托管版)

-

GitHub 源码地址:https://github.com/openclawd/openclawd(含源码、安装文档、贡献指南,可下载源码二次开发)

-

官方安装文档:https://openclawd.ai/install(分平台详细安装步骤,含一键脚本、Docker、源码安装教程)

2. 学习视频资源

-

B站:搜索“OpenClaw 安装教程”“OpenClaw 新手入门”,可找到国内开发者分享的中文实操视频,涵盖托管版、自托管版完整配置流程。

-

YouTube:搜索“OpenClaw Tutorial”“OpenClaw Self-Host Guide”,查看官方及海外开发者分享的进阶教程,含技能开发、多模型配置技巧。

3. 文档与社区资源

-

DataHub 数据社区:OpenClaw 安装完全指南(小白友好),含详细步骤、配图和常见问题解决方法。

-

GitHub 社区:项目 Issues 板块可查询常见问题,Discussions 板块可交流使用技巧、寻求技术支持,也可提交 bug 和功能建议。

-

技能开发文档:官方文档含技能开发指南,支持用 JavaScript/TypeScript 开发自定义技能,可参考社区技能案例快速上手。

九、官网演示相关(无官方截图,附详细描述)

-

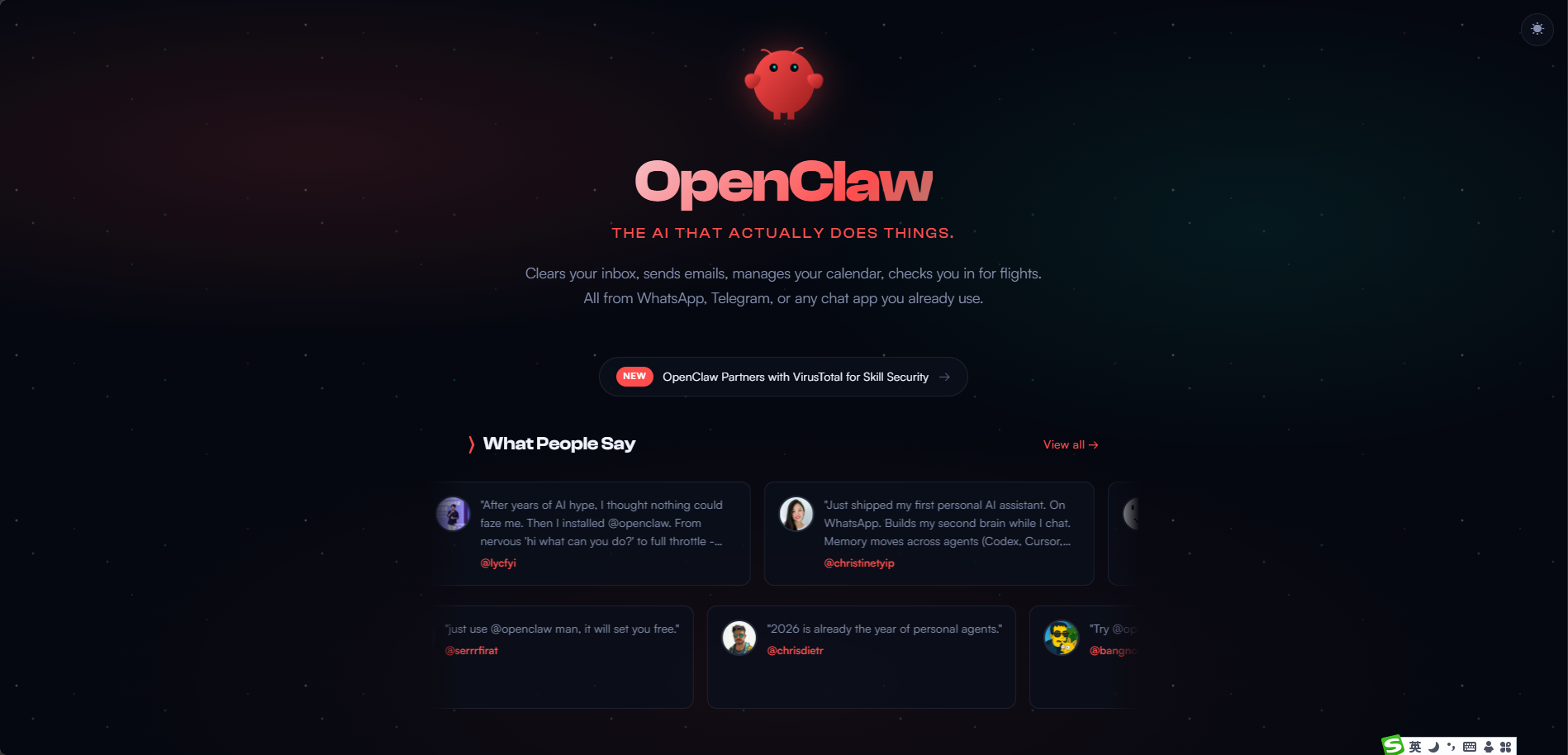

官网首页:顶部展示“OPEN SOURCE • SELF-HOSTED • 100+ INTEGRATIONS”核心标签,突出开源、自托管、多集成三大优势;中间展示 OpenClaw AI 核心定位,下方分模块呈现核心功能、安装方式、支持平台等内容,整体简洁清晰,重点突出实操性。

-

Web 控制台演示:通过 localhost:18789 访问,包含聊天面板、模型配置、渠道管理、技能市场四大核心模块,界面简洁,支持拖拽配置,可直观查看任务执行日志和技能状态。

-

交互演示:支持网页端聊天、聊天平台(Telegram/Discord)调用两种方式,指令输入后实时流式输出执行过程,可查看任务进度和结果,交互流畅,无需复杂操作。

腾讯企业邮箱(现升级为企业微信邮箱)是腾讯推出的企业级邮件服务,主打微信 / 企业微信深度集成、安全稳定、管理可控、移动办公,是国内最贴合微信生态的企业邮箱方案,适合各类规模企业的内外沟通与知识沉淀腾讯企业邮箱。